Das Wichtigste zu Auditierbarkeit und Nachvollziehbarkeit von KI-Entscheidungen

Inhaltsverzeichnis

- Transparenz in KI ist entscheidend für Vertrauen.

- Auditierbarkeit hilft Fehler und Bias zu identifizieren.

- Nutzer erwarten Erklärbarkeit von KI-Entscheidungen.

- Vielfalt in den Daten vermindert Diskriminierung.

- Regulatorische Anforderungen fördern aktive Auditierungen.

Einleitung

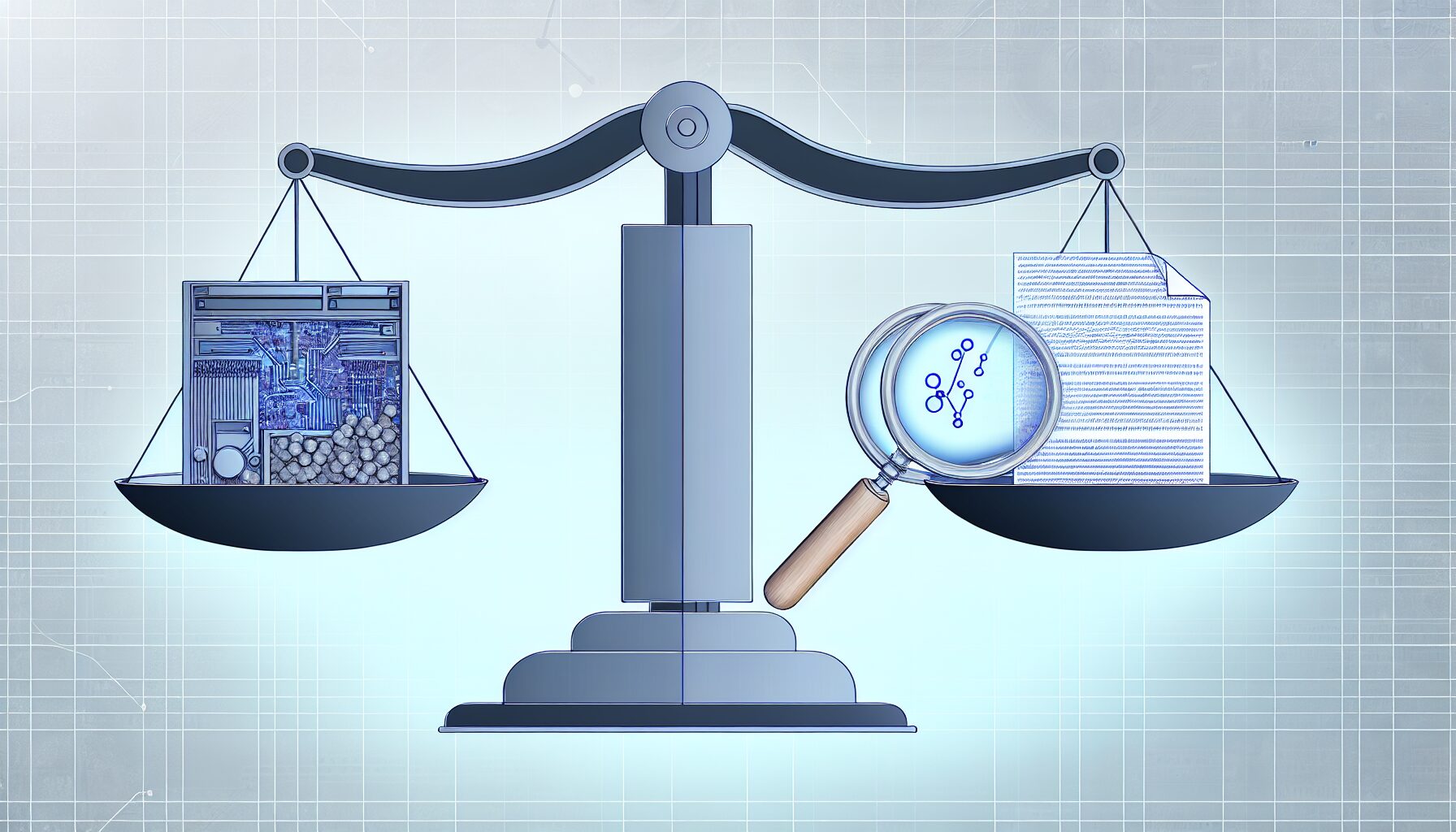

In einer Welt, in der künstliche Intelligenz immer mehr Entscheidungen beeinflusst, ist die Frage der Auditierbarkeit von zentraler Bedeutung. Was bedeutet es aber wirklich, wenn wir von auditierbaren KI-Systemen sprechen? Lassen Sie uns in eine tiefere Analyse eintauchen.

Warum Auditierbarkeit von KI-Systemen entscheidend ist

Im Kern bedeutet Auditierbarkeit, dass der Entscheidungsprozess einer KI nachvollziehbar ist. Dies ist aus mehreren Gründen wichtig:

- Fehlererkennung: Audits können helfen, Fehler im System zu identifizieren.

- Bias-Verhinderung: Systeme können auf Vorurteile überprüft werden.

- Vertrauensbildung: Transparenz schafft Vertrauen bei den Nutzern.

Erhöhte Nachfrage nach Transparenz

Nutzer fordern vermehrt, dass KI-Systeme Entscheidungen erklärbar machen. Eine Studie von PWC zeigt, dass 67% der Bevölkerung mehr Erklärungen wünschen. Die Erfüllung dieser Erwartung ist entscheidend für die Akzeptanz von KI.

Rechtliche Anforderungen

Die Europäische Datenschutz-Grundverordnung (DSGVO) fordert, dass algorithmische Entscheidungen nachvollziehbar sein müssen. Regulierungen wie diese fördern aktiv die Auditierung von KI-Systemen. Der Artikel von eugdpr.org bietet weitere Einblicke.

Technische Herausforderungen bei der Auditierbarkeit

Trotzdem stellt die praktische Umsetzung von Auditierbarkeit Herausforderungen dar. Die Komplexität von Algorithmen und die Menge an einbezogenen Daten erschweren diesen Prozess.

Vielfalt der Daten

Wie das OpenAI-Blog erklärt, ist die Vielfalt der verwendeten Daten entscheidend, um Bias zu minimieren und faire Entscheidungen zu garantieren. Daten aus unterschiedlichen Quellen und mit verschiedenen Perspektiven tragen entscheidend hierzu bei.

Fragen zur Diskussion

Gibt es überhaupt eine perfekte Auditierbarkeit von KI-Systemen?

Perfekte Auditierbarkeit wäre der goldene Standard, den viele Experten sich wünschen. In der Praxis ist es jedoch schwierig, absolute Perfektion in der Auditierbarkeit zu erreichen. Vor allem bei komplexen Modellen wie tiefen neuronalen Netzwerken gibt es inhärente Herausforderungen. Die perfekte Auditierbarkeit würde ein vollständiges Verständnis sowohl der einfließenden Daten als auch der Algorithmen erfordern – ein Unterfangen, das bei der aktuellen technologischen und regulatorischen Lage nahezu unmöglich scheint. Es erfordert umfassende Kenntnisse in mehreren Bereichen und einen enormen Aufwand. Das Ziel sollte daher eher in der ständigen Verbesserung der Transparenz und der Nachvollziehbarkeit der Systeme liegen. Systeme sollten so transparent wie möglich gestaltet sein, während gleichzeitig darauf geachtet wird, dass die Datenintegrität und das Einhalten von Datenschutzstandards gewährleistet sind. Dies kann durch kontinuierliche Tests und Rückmeldungen aus der Praxis erreicht werden. Daher bleibt Auditierbarkeit ein fortlaufendes Ziel, keine einmalige Errungenschaft.

Ist es nicht ironisch, dass wir Menschen Maschinen auditieren müssen, die wir selbst erschaffen haben?

Auf den ersten Blick mag es ironisch erscheinen, dass wir Kreaturen schaffen und dann Mühe aufbringen, um deren Entscheidungen zu überprüfen. Diese Ironie verdeutlicht jedoch nur unsere Verantwortung als Schöpfer dieser Technologie. Der Einsatz von KI-Systemen ist das Ergebnis menschlicher Leistung, und während deren Nutzung exponentiell wächst, darf man nicht vergessen, dass diese Algorithmen und Maschinen menschliche Werte und Vorurteile widerspiegeln können. KI-Systeme agieren in einer Geschwindigkeit und Skala, die herkömmliche menschliche Verständnismodule übersteigen. Daher ist die Note der Überprüfung, oder Auditierung, ein essenzieller Schritt, um sicherzustellen, dass diese Systeme fair, sicher und effektiv arbeiten. Die Kontrolle dieser Systeme ist nicht nur ein Erfordernis der Technologie, sondern auch unserer Verantwortung gegenüber unserer Gesellschaft, um sicherzustellen, dass die Technologie ethisch und effektiv bleibt. Das Besondere dabei ist der Fortschritt durch kontinuierliches Überprüfen und Erlernen, welche nicht nur die Maschinen, sondern auch die Erbauer dieser Systeme besser machen helfen.

Sind Auditierungen von KI-Systemen nicht einfach ein weiteres Bürokratietool?

Es mag wie eine weitere Bürokratieschicht wirken, aber die Realität sieht komplexer aus. Auditierungen sind nicht nur Bürokratie, sondern können als Sicherheitsnetz verstanden werden. Diese Auditierungen stellen sicher, dass KI-Systeme nicht zu unkontrollierten Black Boxes werden. Sie sind ein proaktives Mittel, um die Leistungsfähigkeit und Sicherheit der Technologie zu garantieren. Auditierungen können auch Innovationsprozesse beschleunigen. Wenn diese als Feedback-Mechanismus betrachtet werden, geben sie wertvolle Einblicke, welche Optimierungen und Verbesserungen notwendig sind. Statt ein Hindernis zu sein, fungieren sie als Katalysator für Qualität und Vertrauen. Damit zeigen Auditierungen ihre wahre Stärke: Sie bieten eine Plattform, auf der Verantwortlichkeit und Fortschritt aufeinandertreffen.

Kann man ironisch sagen, dass Algorithmen wirklich ehrlicher sind als Menschen?

Auf den ersten Blick könnte man das behaupten, denn Algorithmen handeln ohne die Unsicherheiten und emotionalen Schwankungen, die Menschen beeinflussen. Sie gehorchen der Logik der Mathematik und Daten. Doch ehrlich bedeutet nicht unbedingt objektiv oder neutral. Algorithmen sind das Produkt menschlicher Schöpfung, konfiguriert nach menschlichen Vorlieben und Vorurteilen. Die Ehrlichkeit eines Algorithmus kann und wird durch die Daten beeinflusst, die er bekommt, sowie durch die Ziele, die ihm auferlegt werden. Algorithmen wissen nicht, was richtig oder falsch ist; sie führen einfach die Anweisungen aus, die der Mensch ihnen gegeben hat. Daher ist die „Ehrlichkeit“ eines Algorithmus nur so gut, wie die ethischen Standards der Entwickler und die Integrität der Daten. Dies unterstreicht, wie entscheidend es ist, sorgfältige und durchdachte Auditierungsprozesse in die KI-Entwicklung zu integrieren.

Sind wir auf dem besten Weg, von auditierbaren Superman-Maschinen beherrscht zu werden?

Es ist eine provokante Vorstellung, unsere Zukunft von KI beherrscht zu sehen, die ihre Prozesse auditieren lässt. Aber es wäre zu einfach, die Zukunft so düster zu malen, ohne die Vorteile und Herausforderungen zu erkennen, die KI bietet. Auditierbarkeit gewährleistet nicht das Szenario einer neuen Kontrolle, sondern eher einer Aufsicht, die menschliche Werte und Regeln respektiert. Es ist die Verantwortung der Entwickler und der Gesellschaft als Ganzes, sicherzustellen, dass die Regulation und Steuerung von KI donnd ein ethisch gefestigtes Rückgrat haben. Dies bedeutet, dass während der Aufstand der Maschinen ein lustiges Science-Fiction-Thema sein mag, die Realität von spezifiziertem und transparentem Einsatz von KI eher Kooperation fördert statt Dominanz. Auditierte KI kann als Werkzeuge gesehen werden, um unsere Probleme stärker anzugehen, und sie unterstützen uns dabei, sicherere und effizientere Umgebungen zu schaffen.